L’adoption de l’intelligence artificielle (IA) en milieu professionnel s’accélère à un rythme difficile à ignorer. Selon une étude de McKinsey publiée en 2024, 65 % des organisations sondées utilisaient déjà l’IA générative (soit des outils capables de produire du texte, des images ou des analyses à partir d’instructions) dans au moins une fonction d’affaires, soit le double par rapport à l’année précédente (McKinsey & Company, 2024). Au Canada, le Conference Board du Canada rapportait en 2023 que près de la moitié des entreprises canadiennes prévoyaient intensifier leur utilisation de l’IA dans les 12 à 18 mois suivants.

Pourtant, derrière ces chiffres encourageants se cache une réalité plus nuancée. L’intérêt est là. L’adoption de l’IA en entreprise, elle, accroche souvent – non pas par manque d’outils, mais par manque d’accompagnement humain.

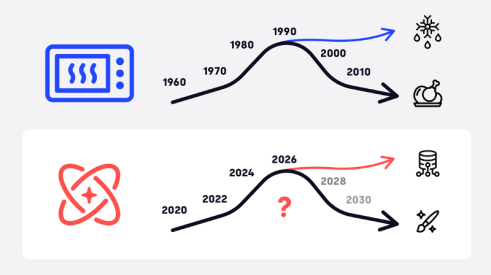

Le fossé entre l’intérêt et l’adoption

Il existe un écart bien documenté entre l’enthousiasme autour de l’IA et l’adoption de l’IA concrète au sein de l’organisation. Une enquête de Salesforce menée en Amérique du Nord en 2024 révèle que si 84 % des responsables en technologies croient que l’IA générative améliorera leur productivité, seulement 35 % de leurs employés se disent confiants dans leur capacité à l’utiliser efficacement (Salesforce, 2024).

Cet écart n’est pas une question de technologie. ChatGPT, Copilot, Gemini et d’autres outils similaires sont accessibles, abordables et fonctionnels. Le problème est ailleurs : les employés ne savent pas concrètement comment aborder l’intégration de l’IA dans leur quotidien, et les organisations peinent à leur offrir un point de départ clair. Résultat : les bons outils sont abonnés, parfois même payés, mais rarement utilisés à leur plein potentiel dans chaque secteur d’activité.

Former, pas juste déployer

La première étape pour réduire ce fossé est souvent la plus négligée : la formation. Installer un outil d’IA sans accompagnement, c’est un peu comme remettre un nouveau logiciel complexe à une équipe sans documentation ni formation. L’outil existe, mais personne ne sait vraiment quoi en faire.

Ce que nous avons observé, c’est que la formation la plus efficace ne porte pas sur l’outil lui-même, mais sur des cas d’usage concrets liés au travail réel des équipes. Former un analyste à utiliser l’IA pour automatiser la saisie de données ou accélérer l’analyse de données, c’est différent de lui expliquer le fonctionnement théorique du machine learning (apprentissage automatique). L’un crée une habitude, l’autre génère de la confusion.

Un exemple simple : dans notre propre démarche, nous avons mis en place des sessions pratiques courtes (30 à 45 minutes) où les employés peuvent partager leurs utilisations des assistants d’IA. Rédaction d’un courriel, résumé de réunion, reformulation d’un document. Ce type d’exercice permet de bâtir une première expérience IA concrète, sans nécessiter de grandes connaissances techniques.

Gérer les résistances

Les résistances face à l’IA sont légitimes et méritent d’être prises au sérieux, pas minimisées. Les craintes les plus fréquentes que nous entendons tournent autour de trois axes : la peur de perdre son emploi, l’inquiétude liée à la vie privée et à la confidentialité des données, et le sentiment de ne pas être à la hauteur techniquement.

Sur la question de l’emploi, les données actuelles suggèrent que l’IA transforme davantage les tâches répétitives qu’elle ne supprime des postes entiers – du moins à court terme. Ce qui change, c’est la nature du travail, et non son existence. Sur la confidentialité, la prudence est justifiée : il faut établir des règles claires et des bonnes pratiques sur ce que les équipes peuvent (ou ne peuvent pas) partager avec les systèmes d’IA, notamment dans les secteurs sensibles comme la cybersécurité, la santé ou le droit. Se doter d’une politique d’utilisation de l’IA à l’interne est une étape concrète et souvent sous-estimée – elle balise les usages acceptables, protège l’organisation et rassure les employés qui ne savent pas jusqu’où ils peuvent aller.

La résistance disparaît rarement par décret ou par enthousiasme de la direction. Elle diminue quand les personnes concernées voient, par elles-mêmes, que l’outil leur facilite la vie – et non qu’il les surveille ou les remplace.

Une adoption qui prend du temps

L’adoption de l’IA en entreprise est un processus d’amélioration continue, pas un projet avec une date de fin. Un projet pilote bien ciblé, une formation ancrée dans la pratique et une écoute sincère des résistances constituent de meilleures fondations que le déploiement précipité de solutions d’IA à grande échelle. Les grandes entreprises qui réussissent leur transformation numérique le font rarement en un seul mouvement – elles avancent par étapes, en ajustant au fil des apprentissages.

Ce qui freine le plus l’adoption de l’IA à long terme, ce n’est pas la technologie. C’est l’absence d’un espace pour apprendre à s’en servir, et la vitesse à laquelle on demande aux équipes de changer leurs habitudes. Aller vite, oui – mais pas sans les gens.

Sources : McKinsey & Company, « The state of AI in 2024 », mai 2024. Salesforce, « Generative AI Snapshot Research Series », 2024. Conference Board du Canada, « Intelligence artificielle et avenir du travail au Canada », 2023.